Algoritmos têm se mostrado ferramentas de reprodução de preconceito, injustiça e discriminação. Num ambiente automatizado, questões de gênero e de raça podem resultar em exclusão ou perpetuação de desvantagens.

Às vésperas do primeiro aniversário do assassinato de George Floyd, fato que desencadeou manifestações antirracistas pelo planeta, o Twitter concluiu que a inteligência artificial tende a cortar imagens de negros em fotos na rede social.

A informação foi divulgada pela imprensa na semana passada e consta de pesquisa realizada pela própria empresa para identificar se seu algoritmo é preconceituoso. O estudo foi motivado por críticas sobre a exclusão de rostos de pessoas negras em prévias de posts.

Algoritmos são códigos com instruções para execução de uma tarefa ou solução de um problema e, na atualidade, representam a forma mais eficiente para identificar, organizar e atingir um mercado. Assim como podem ser inclusivos, está comprovado que são também absurdamente excludentes.

Por isso, uma questão relevante é quem os programa, como e com que motivação. Conscientemente ou não, preconceitos são embutidos nos algoritmos e reproduzidas pelas máquinas.

No livro "Algoritmos de destruição em massa", a cientista de dados Cathy O’Neil fala em modelos matemáticos tomando decisões que afetam nossas vidas diretamente. Coisas como quem é contratado ou demitido, ou a escolha de um candidato.

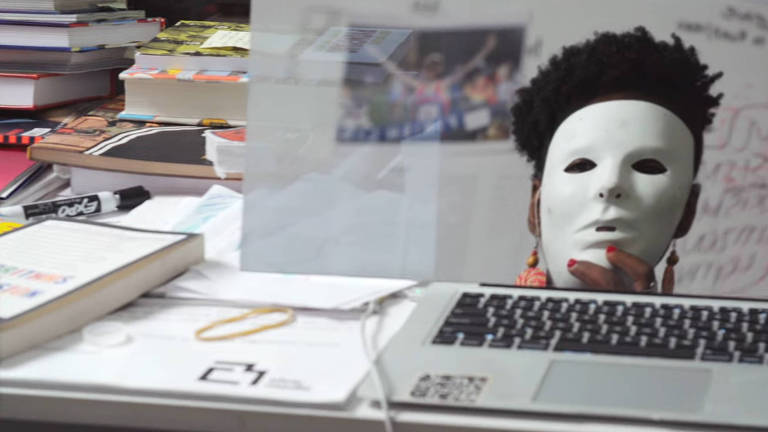

Fundadora da Algorithmic Justice League, a cientista da computação Joy Buolamwini, do MIT, compara os algoritmos aos vírus em razão da capacidade de disseminarem preconceito em larga escala e em ritmo acelerado. A analogia é tão didática quanto assustadora, especialmente em tempos de pandemia.

Se é verdade que ninguém nasce racista, o mesmo não se aplica aos algoritmos. Como diz meu amigo Carlinhos Muller, “se um algoritmo é racista, isso faz parte de seu DNA”.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.