No dia 28 de maio, Donald Trump assinou uma ordem executiva [equivalente a um decreto presidencial no Brasil] para prevenir censura online, com regras a serem implementadas por outros órgãos para atingir as plataformas de internet que se baseiam em conteúdos produzidos por usuários. Lá como cá, o nome de uma lei não diz exatamente o que ela faz —inclusive porque não há hoje consensos em torno do que garante a liberdade de expressão ou um ambiente informacional seguro e não manipulado.

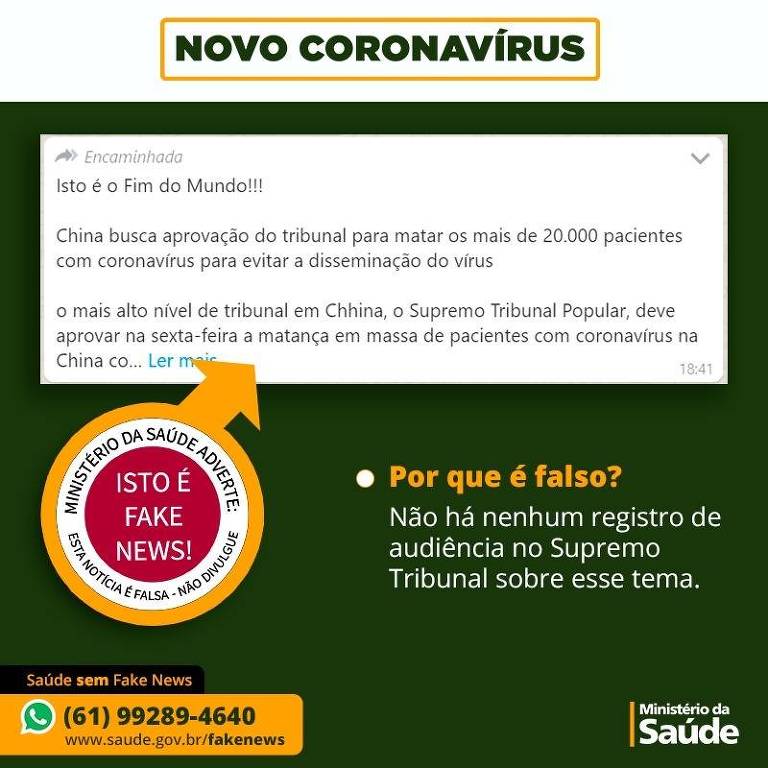

No dia 26 de maio, o Twitter havia colocado rótulos de checagem em tuítes de Trump que tratavam de cédulas de votação por correio. Os rótulos levavam a links que questionavam a veracidade das afirmações dele. É um exemplo de medidas que as grandes plataformas de internet vêm desenvolvendo para responder à disseminação de desinformação nos seus ambientes —e que vêm sendo reforçadas durante a pandemia.

A ordem executiva de Trump foi uma resposta à insatisfação que ele e outros atores conservadores vinham ventilando, de que as plataformas de internet favorecem discursos progressistas. Não há evidências disso, e há inclusive pessoas argumentando em contrário. Como resposta, Trump propõe que a FCC (Federal Communications Commission) dê uma nova interpretação para a Seção 230 do Communications Decency Act, uma lei de 1996 que dá imunidade a plataformas pelos conteúdos postados pelos seus usuários, desde que elas cumpram com algumas condições.

A ideia por trás desse modelo é que as plataformas não se engajem em controle prévio do que é permitido, como discurso, ou não –o que não impede que elas tenham as próprias regras de moderação. No modelo da nova ordem executiva de Trump, empresas que se engajam em censura de conteúdos não poderiam mais gozar dessa imunidade. Ou seja, elas passariam a ser responsáveis pelo conteúdo dos usuários.

Regulação nos temas de desinformação e plataformas de internet estão na ordem do dia –aqui como lá. Recentemente, o projeto Sleeping Giants movimentou o cenário no Brasil, praticando constrangimento contra marcas que anunciam em sites que propagam notícias falsas.

De alguma forma, com uma estratégia que a ordem executiva de Trump também tem, mas com o sinal trocado –a Seção 3(c) da Ordem determina que o Departamento de Justiça norte-americano vai avaliar quais plataformas são veículos problemáticos para o governo por “discriminar por ponto de vista, enganar consumidores, ou outras práticas ruins”, e que o governo federal não anunciará nelas.

Em comum, as duas estratégias tentam atingir objetivos mexendo com o modelo de negócios das plataformas e sites de internet. Não é só atingindo anunciantes que os bolsos dos atores econômicos são afetados nessa discussão.

Quando a ordem de Trump ou versões do projeto de lei 2.630/20 —“o PL das fake news” que virou alvo de disputa, um tanto mal colocada, pró e contra o governo no Twitter nos últimos dias— miram no regime de responsabilidade das plataformas sobre o que os usuários postam, eles mexem também tanto com custos envolvidos no controle de conteúdos de usuários que as plataformas farão, quanto com o quanto elas podem pagar em indenizações pelos danos causados por esses conteúdos.

Nesse aspecto, a decisão de Trump e o PL 2630/20 se assemelham, mas com sinais trocados: de um lado, a partir da iniciativa das plataformas de controlar conteúdos, de outro pela sua inação em fazer isso. Evidentemente, esse é o campo de disputa.

Em um caso e no outro, movidos por poucas evidências e por altas expectativas em promover o resultado político que se deseja.

Enquanto isso, as organizações de direitos digitais vêm debatendo o tema a partir das experiências internacionais e uma visão mais abrangente dos efeitos colaterais de determinadas soluções que podem parecer boas de saída. Afinal, quem poderia ser contra combater fake news?

É momento de focar nesse conhecimento e evitar pensar que uma solução pode ser bala de prata: saídas para a desinformação passam por soluções múltiplas. Elas vão envolver a discussão de modelos de financiamento dos veículos de informação na internet (de Sleeping Giants à publicidade pública nesses conteúdos), saídas jurídicas equilibradas que balizem a moderação de conteúdos respeitosa dos direitos envolvidos, distribuição de responsabilidade na cadeia (como por exemplo regulando o comércio de likes e o disparo em massa de mensagens políticas), medidas para combater violência contra a expressão de grupos minorizados, transformações políticas e culturais em como se faz debate, e mesmo a ação de instituições do Estado reforçando os valores democráticos.

Acreditar que uma única solução com tantos riscos colaterais vai dar conta conduz tanto ao PL 2360/20 quanto à ordem executiva de Trump.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.