Um novo conjunto de leis que regem o uso da inteligência artificial (IA) na União Europeia forçará as empresas a serem mais transparentes sobre os dados usados para treinar seus sistemas, revelando um dos segredos mais bem guardados da indústria.

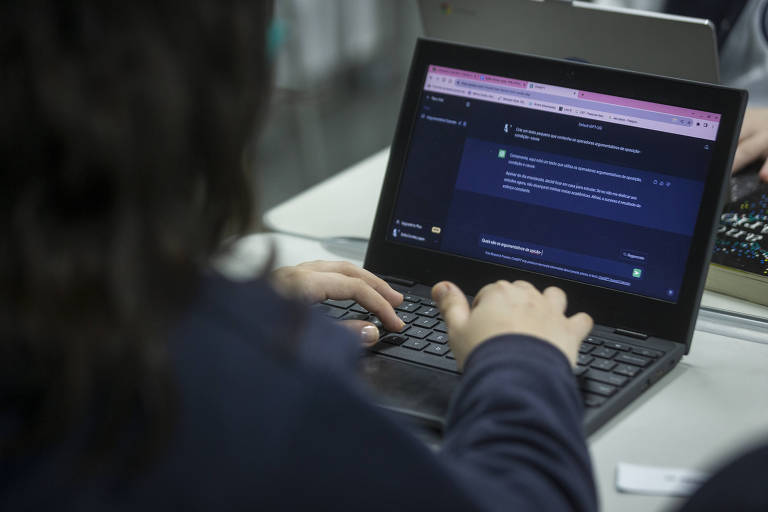

Nos 18 meses desde que a OpenAI, apoiada pela Microsoft, lançou o ChatGPT ao público, houve um aumento do engajamento público e dos investimentos em IA generativa, um conjunto de aplicações que podem ser usadas para produzir rapidamente textos, imagens e conteúdo de áudio.

Mas, à medida que o setor cresce, surgem questões sobre como as empresas de IA obtêm os dados usados para treinar seus modelos, e se alimentar esses modelos com livros best-sellers e filmes de Hollywood sem a permissão de seus criadores constitui uma violação de direitos autorais.

A recém-aprovada Lei de IA da UE está sendo implementada em fases ao longo dos próximos dois anos, dando aos reguladores tempo para aplicar as novas legislações enquanto as empresas enfrentam um novo conjunto de obrigações. Mas não está claro ainda como algumas dessas regras funcionarão na prática.

Uma das seções mais controversas da lei afirma que as organizações que utilizam modelos de IA de propósito geral, como o ChatGPT, terão que fornecer "resumos detalhados" do conteúdo usado para treiná-los. O recém-estabelecido gabinete de IA disse que planeja lançar um modelo para as organizações seguirem no início de 2025, após uma consulta com as partes interessadas.

Embora os detalhes ainda precisem ser definidos, as empresas de IA são altamente resistentes a revelar com o que seus modelos foram treinados, descrevendo as informações como um segredo comercial que daria aos concorrentes uma vantagem injusta se fosse tornado público.

"Seria um sonho realizado ver os conjuntos de dados dos meus concorrentes, e o mesmo vale para eles verem os nossos," disse Matthieu Riouf, presidente-executivo da Photoroom, empresa de edição de imagens com IA.

O quão detalhados esses relatórios de transparência acabarão sendo terá grandes implicações para startups de IA menores e para grandes empresas de tecnologia como Google e Meta, que têm colocado a tecnologia no centro de suas operações futuras.

Com reportagem adicional de Leigh Thomas

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.