Os impressionantes saltos técnicos nos serviços de inteligência artificial nos últimos vinte anos aceleraram o senso de maravilha sobre as tecnologias digitais. Reconhecimento de objetos em imagens, tradução automática, anúncios hipercontextualizados, carros semi-automatizados e plataformas de transporte são apenas alguns que precederam o queridinho da vez: o ChatGPT que, representando os grandes modelos de linguagens, pareceu chacoalhar o já efervescente campo da inteligência artificial.

A recente carta de vários CEOs de tecnologia que pediu uma pausa de seis meses no desenvolvimento de IA provou ser uma jogada de especulação com o capital financeiro e uma peça de desinformação estratégica. Enquadrar o debate ético sobre inteligência artificial como incipiente ou como ligado a robôs conscientes esconde os problemas da IA hoje, em especial sobre o aprofundamento das desigualdades e concentração de poder econômico, político e epistêmico.

Temos sim um debate complexo e consideravelmente maduro sobre regulação de inteligência artificial no mundo, inclusive no Brasil.

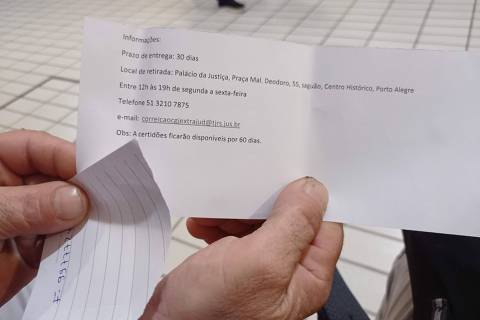

No último dezembro, uma comissão de juristas responsável por subsidiar a elaboração de substitutivo sobre inteligência artificial, entregou ao presidente do Senado um denso e longo relatório resultante dos debates entre experts da comissão, audiências públicas e contribuições multisetoriais.

O relatório incluiu minuta de substitutivo aos projetos de lei anteriormente apresentados, avançando substancialmente na promoção de direitos sem podar inovação. Porém, o texto ainda carece de compromisso antirracista, talvez fruto da própria composição da comissão: nenhum dos 18 juristas convidados é uma pessoa negra ou indígena.

Em seminário realizado no Conselho da Justiça Federal em abril, em Brasília, a maior parte da complexa rede de interesses multissetoriais na matéria concordou que é o momento de avançar para tramitação.

Tornou-se o Projeto de Lei n° 2338/2023, protocolado pelo senador Rodrigo Pacheco, abrindo o espaço para o debate legislativo de fato. Seria benéfica uma participação social mais intensa que abra espaços para organizações e especialistas colaborarem com sugestões que favoreçam o combate ao racismo algorítmico e suas manifestações, já amplamente identificadas pela academia e pelo jornalismo em implementações que incluem de filtros para selfies, tecnologias de vigilância e recrutamento até acesso a saúde e a recursos públicos.

Se o nosso Estatuto da Igualdade Racial estabelece a promoção de ajustes normativos para aperfeiçoar o combate à discriminação étnico-racial e às desigualdades étnico-raciais em todas as suas manifestações individuais, institucionais e estruturais, ainda há muito a avançar.

O Brasil apresenta pesadas vulnerabilidades na defesa de direitos humanos e infelizmente lidera alguns índices de desigualdade, racismo, violência de gênero e LGBTQfobia. A factualidade das violências e desigualdades no Brasil não pode ser ignorada na construção de mecanismos de controle social da tecnologia.

O texto proposto pela comissão se inspira fortemente no relevante AI Act da União Europeia, mas falha ao desconsiderar que o Brasil precisa de mais defesa de direitos para alcançar em algum momento níveis aceitáveis de bem-estar social.

Um exemplo é a abordagem sobre o reconhecimento facial no espaço público, notadamente seu uso pelo Estado e pelas polícias. Banimento ou longas moratórias de tecnologias nocivas deveriam estar no rol de possibilidades de regulação federal.

Campanhas globais e nacionais como a Ban Biometric Surveillance e a TireMeuRostodaSuaMira, assim como o protocolaço #SaidaMinhaCara, são exemplos que reúnem centenas de organizações da sociedade civil que pedem pelo banimento do uso de vigilância biométrica à distância, como o reconhecimento facial. O texto brasileiro, porém, estabeleceu regras frouxas para seu uso, promovendo o encarceramento em massa e a hipervigilância em um país que tem mais anos de regimes ditatoriais do que democráticos.

A produção de bancos de dados e sistemas éticos diversos, abertos e multidisciplinares pode ser um pilar do talento multicultural brasileiro e diferenciar o país como uma liderança global no tema. Para alcançar isso, podemos olhar também para experiências e caminhos além do eixo Europa e EUA.

Por exemplo, a "Declaração Windhoek de países do Sul da África sobre Inteligência Artificial" recomenda a promoção de "decolonização no design e aplicação de tecnologias de IA, incluindo decolonizar a educação em todos os níveis, desenvolvendo currículos centrados na África e envolvendo comunidades para co-desenhar aplicações éticas e inclusivas, levando em conta a herança cultural e os sistemas de conhecimento de povos originários".

O Brasil tem riqueza humana, histórica e cultural para liderar a produção de tecnologias digitais éticas e combate a vieses de conhecimento em um mundo multipolar.

Finalmente, a gradação de risco de implementações de IA, em especial os conceitos de alto risco e risco inaceitável, deve considerar as disparidades interseccionais conhecidas no Brasil. Para tal, a ideação de uma autoridade nacional sobre a IA deve incluir organizações da sociedade civil e pesquisadores sobre opressões interseccionais, tais como redes institucionais de promoção de igualdade racial.

Desvelar a negação do racismo em todas suas manifestações, inclusive o algorítmico, é uma missão que vai abrir os caminhos para o nosso futuro.

O editor Michael França pede para que cada participante do espaço "Políticas e Justiça" da Folha sugira uma música aos leitores. Nesse texto, a escolhida por Tarcizio Silva foi "Strange Arithmetic", de The Coup.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.