As possíveis aplicações da inteligência artificial e suas consequências nortearam o segundo dia do TED 2018, conferência que reúne líderes globais de diversas áreas de estudo em Vancouver, no Canadá, nesta quarta (11).

Em sua palestra, Max Tegmark, cosmólogo e professor do Instituto de Tecnologia de Massachusetts (MIT), instigou a plateia a imaginar que tipo de sociedade futura gostaríamos de atingir com o uso da tecnologia.

"Quais queremos que sejam os papéis dos seres humanos se as máquinas puderem fazer tudo melhor e mais barato do que nós?", questionou o cientista.

Para ele, essa é a pergunta central que devemos fazer neste momento, antes de aprimorar os modos de aprendizado de máquina, o que, segundo ele, poderia causar danos irreversíveis e inclusive a extinção humana se não for planejado.

"No caso de armas mais poderosas, como bombas nucleares e inteligência artificial geral, aprender com o erro seria uma péssima tragédia", diz o cientista. "É muito melhor ser proativo do que reativo, planejar com antecedência e acertar de primeira, porque essa pode ser a única chance que teremos."

Seu discurso gira em torno da possibilidade de a ciência alcançar a chamada inteligência artificial geral, ou seja, um estágio em que a tecnologia tenha avançado a ponto de máquinas conseguirem realizar qualquer tarefa intelectual que hoje apenas um humano é capaz.

Tegmark é um dos fundadores do Instituto Future Life, organização sem fins lucrativos que tinha como um dos membros de seu conselho o físico Stephen Hawking, morto em março, e o objetivo de reduzir riscos que a humanidade enfrenta com o avanço de tecnologias.

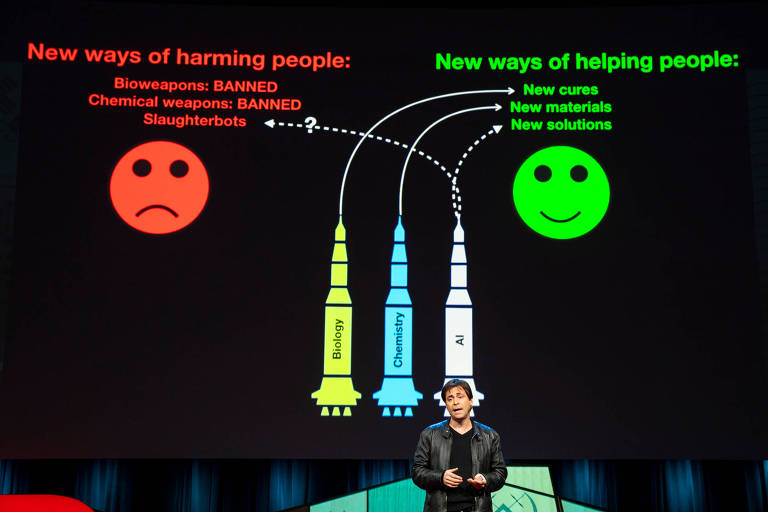

Na conferência, o cosmólogo citou alguns princípios que um grupo de pesquisadores na área de inteligência artificial se comprometeu a seguir. Um deles, e talvez o principal, seria evitar uma corrida armamentista e banir armas autônomas e letais.

"A ideia aqui é que qualquer ciência pode ser usada para novas maneiras de ajudar pessoas ou novas maneiras de prejudicar pessoas", disse.

NA PRÁTICA

Além de Max Tegmark, outros palestrantes abordaram o assunto com propostas concretas de aplicações da inteligência artificial.

O físico chileno Cesar Hidalgo, também professor do MIT, debateu a possibilidade de utilizar o aprendizado de máquina para fundamentar e fortalecer o modelo de futuras democracias.

Sua ideia seria automatizar votações de projetos e a criação de leis por meio de avatares individuais que conheçam seus donos tão bem quanto eles mesmos.

O recurso seria altamente personalizado e passível de ajustes para atender aos interesses da pessoa representada. Hidalgo propõe longos testes da ferramenta em ambientes controlados, como uma universidade, antes de aplicá-la a sistemas eleitorais e legislativos.

Já a cientista Poppy Crum, professora da Universidade Stanford, sugeriu unir neurociência e inteligência artificial para treinar máquinas na identificação de sentimentos humanos.

Segundo a pesquisadora, o intuito seria aprimorar a maneira como relacionamos com o mundo ao redor no que ela chamou de Era da Empatia. "Tecnologias hoje podem e irão saber o que estamos sentindo", diz.

Seu projeto se baseia na leitura de sinais fisiológicos como a composição química do hálito, alterações da pupila e a temperatura do corpo, além de conceitos de linguística, para identificar psicopatias e doenças, como demência, diabete B, esquizofrenia e mal de Alzheimer.

"Imagine um diretor de uma escola que pode perceber que um estudante estava passando por um período difícil. Imagine autoridades serem capazes de distinguir alguém com problemas mentais de alguém com um comportamento agressivo e poderem agir de acordo", exemplifica.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.