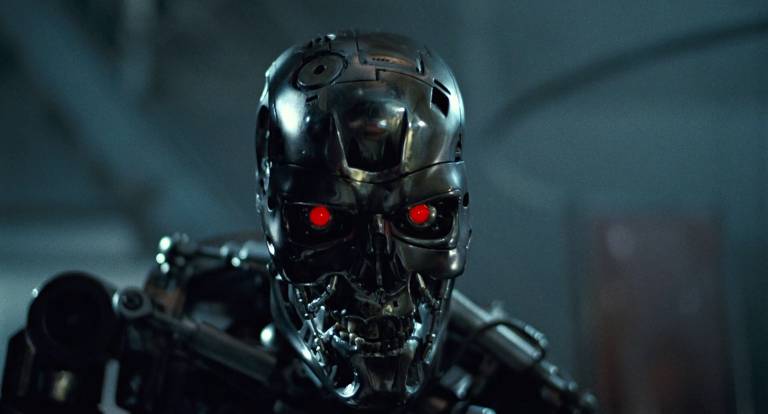

Do sexto capítulo da franquia Exterminador do Futuro só vi o trailer, o bastante para ficar apavorado com o destino sombrio de Sarah Connor. Agora, pânico, mesmo, veio ao saber que já se discute um tratado para banir robôs assassinos.

Como assim, não era tudo ficção científica? Já não bastassem os robôs da internet mobilizados para assassinar reputações e a objetividade, agora querem proscrever também armas autônomas baseadas em inteligência artificial capazes de matar gente.

Há no Brasil pelo menos uma família convencida de que armas não matam —pessoas é que matam, dizem. Pois bem, só os admirados EUA preveem orçamento de US$ 3,7 bilhões (mais de R$ 15 bilhões) no ano fiscal de 2020 para desenvolver sistemas armados sem operador.

A iniciativa para banir tais armas antes que elas comecem a matar sozinhas é capitaneada pela organização Campaign to Stop Killer Robots (campanha para parar robôs assassinos). Ela se baseia no sucesso de movimentos contra bombas de fragmentação e minas terrestres, que até Nobel da Paz já rendeu.

Uma diferença importante está em que esses explosivos já tinham causado muito sofrimento quando entraram na mira das objeções éticas. (Sim, há ética na guerra, embora não pareça; não se devem matar prisioneiros, por exemplo.) Robôs assassinos ainda estão a caminho.

A coisa já havia chegado ao limite com os drones matadores, operados por um ser humano a milhares de quilômetros de distância, livre do risco de morrer em combate. Muita gente sente repulsa espontânea diante do emprego desses armamentos.

Robôs assassinos como os de filmes ainda não existem, mas a Marinha americana desenvolve submarinos não tripulados para usar em ataques, baseados no protótipo Echo Voyager da Boeing. Por que não pequenos drones armados capazes de reconhecer o inimigo e eliminá-los em patrulhas autônomas?

Por várias razões. Se o robô falhar na operação e matar civis, de quem seria a responsabilidade? Do fabricante, do programador, do militar que autorizou o engajamento?

Armamentos que podem ser mobilizados sem risco de baixas na própria tropa reduziriam a inibição de comandantes para entrar em combate. Países que já os desenvolvem, como EUA, Rússia, China, Israel e Coreia do Sul, ganhariam enorme vantagem estratégica sobre o restante.

Há uma lista de 29 países apoiando a ideia de uma moratória, Brasil inclusive. Alguns, como a China, defendem banir só a utilização de armamentos autônomos, não seu desenvolvimento. Americanos e russos, por outro lado, recusam debater um tratado com esse objetivo.

Paradoxalmente, os EUA já dispõem desde 2012 de recomendações éticas internas para suas forças armadas no desenvolvimento e emprego de sistemas autônomos e semi-autônomos (Diretriz 3000.09 do Departamento de Defesa). O princípio geral é garantir “níveis apropriados de julgamento humano sobre o emprego de força”.

Além disso, um Conselho de Inovação em Defesa produziu relatório recente em que se estabelecem cinco princípios para sistemas armados que usem inteligência artificial. Eles têm de permitir responsabilização, equidade, rastreabilidade, confiabilidade e governança.

É um bom começo para discussão. Seria bacana se os EUA liderassem um acordo internacional sobre isso, em lugar de bloqueá-lo. Com Donald Trump no poder por lá e imitadores pipocando pelo globo, a chance é mínima.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.