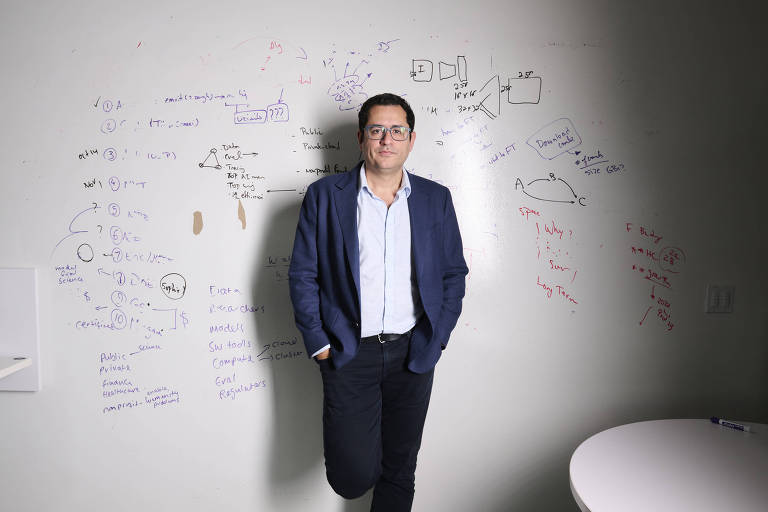

Ali Farhadi não é um rebelde da tecnologia. O cientista da computação de 42 anos é um pesquisador altamente respeitado, professor da Universidade de Washington e fundador da startup de IA Xnor.ai, que foi adquirida pela Apple, onde trabalhava até quatro meses atrás.

Mas o Farhadi, que em julho se tornou diretor executivo do Instituto Allen de Inteligência Artificial, está defendendo uma "abertura radical" para democratizar a pesquisa e o desenvolvimento em uma nova onda de inteligência artificial que muitos acreditam ser o avanço tecnológico mais importante das últimas décadas.

O Instituto Allen iniciou uma iniciativa ambiciosa para construir uma alternativa de inteligência artificial disponível gratuitamente para gigantes da tecnologia como o Google e startups como a OpenAI. Em um processo da indústria chamado código aberto, outros pesquisadores poderão examinar e usar esse novo sistema e os dados inseridos nele.

A postura adotada pelo Instituto Allen, um influente centro de pesquisa sem fins lucrativos em Seattle, coloca-o firmemente de um lado de um debate acirrado sobre o quão aberta ou fechada a nova inteligência artificial deve ser. Abrir a chamada inteligência artificial generativa, que alimenta chatbots como o ChatGPT da OpenAI e o Bard do Google, levaria a mais inovação e oportunidade? Ou abriria uma caixa de Pandora de danos digitais?

As definições do "aberto" significam no contexto da inteligência artificial generativa variações. Tradicionalmente, projetos de software abrem o código-fonte por trás dos programas. Qualquer pessoa pode então examinar o código, identificar bugs e fazer sugestões. Existem regras que determinam se as alterações são feitas. É assim que funcionam projetos de código aberto populares, como o sistema operacional Linux, o servidor web Apache e o navegador Firefox.

Poderosa e imprevisível

Mas a tecnologia de inteligência artificial generativa envolve mais desse código. Os modelos de inteligência artificial são treinados e ajustados com rodadas e mais rodadas de enormes quantidades de dados. No entanto, por mais bem intencionado que seja, os especialistas alertam que o caminho que o Instituto Allen está investigando é perigosamente arriscado.

"As decisões sobre a abertura de sistemas de inteligência artificial são irreversíveis e provavelmente serão algumas das mais importantes do nosso tempo", disse Aviv Ovadya, pesquisador do Berkman Klein Center for Internet & Society da Universidade de Harvard. Ele acredita que acordos internacionais são necessários para determinar quais tecnologias não devem ser divulgadas publicamente.

A IA generativa é poderosa, mas é muitas vezes imprevisível. Consegue escrever instantaneamente emails, poesias e trabalhos acadêmicos, e responder a qualquer pergunta imaginável com fluência semelhante à humana. Mas também tem uma tendência perturbadora de inventar coisas, o que os pesquisadores chamam de "alucinações".

Os principais fabricantes de chatbots –a OpenAI, financiado pela Microsoft, e o Google– mantiveram sua tecnologia mais recente fechada, não revelando como seus modelos de inteligência artificial são treinados e ajustados. O Google, em particular, tinha um longo histórico de publicar suas pesquisas e compartilhar seu software de inteligência artificial, mas cada vez mais manteve sua tecnologia para si, à medida que desenvolvia o Bard.

As empresas afirmam que essa abordagem reduz o risco de criminosos se apropriarem da tecnologia para inundar ainda mais a internet com desinformação e golpes, ou se envolverem em comportamentos mais perigosos. Os defensores dos sistemas abertos liberam os riscos, mas afirmam que ter pessoas mais inteligentes trabalhando para combatê-los é a melhor solução.

Quando a Meta lançou um modelo de inteligência artificial chamado LLaMA (Large Language Model Meta AI) este ano, criou-se um rebuliço. Farhadi elogiou a iniciativa da Meta, mas não acredita que vá longe o suficiente.

"A abordagem deles é basicamente: eu fiz algo mágico. Não vou te dizer o que é", disse ele. Farhadi propõe divulgar os detalhes técnicos dos modelos de inteligência artificial, os dados em que foram treinados, o ajuste fino que foi feito e as ferramentas usadas para avaliar seu comportamento.

O Instituto Allen deu o primeiro passo ao disponibilizar um enorme conjunto de dados para treinar modelos de inteligência artificial. Ele é composto por dados disponíveis publicamente na web, livros, periódicos acadêmicos e código de computador. O conjunto de dados é selecionado para remover informações pessoalmente identificáveis e linguagem tóxica, como frases racistas e obscenas.

Na edição, são feitas escolhas de julgamento. Remover certa linguagem considerada tóxica diminuirá a capacidade de um modelo de detecção de discurso de ódio?

IA é tecnologia de 'caixa preta'

O banco de dados do Instituto Allen é o maior conjunto de dados abertos atualmente disponível, disse Farhadi. Desde que foi lançado em agosto, ele foi baixado mais de 500 mil vezes no Hugging Face, um site de recursos e colaboração de inteligência artificial de código aberto. No Instituto Allen, o conjunto de dados será usado para treinar e ajustar um grande programa de inteligência artificial generativa chamado OLMo (Open Language Model), que será lançado neste ano ou no início do próximo.

Os grandes modelos comerciais de inteligência artificial, disse Farhadi, são tecnologia de "caixa preta". "Estamos defendendo uma caixa de vidro", disse. "Abra tudo e então poderemos discutir o comportamento e explicar em parte o que está acontecendo internamente".

Apenas alguns modelos gerativos de IA principais do tamanho que o Allen Institute tem em mente estão disponíveis publicamente. Eles incluem o LLaMA da Meta e o Falcon, um projeto apoiado pelo governo de Abu Dhabi. O Allen Institute parece ser um lar lógico para um grande projeto de IA.

"É bem financiado, mas opera com valores acadêmicos e tem uma história de ajuda para avançar a ciência aberta e a tecnologia de IA", disse Zachary Lipton, cientista de computação da Universidade Carnegie Mellon.

O Allen Institute está trabalhando com outros para contribuir com sua visão aberta. Este ano, a fundação sem fins lucrativos Mozilla Foundation investiu US$ 30 milhões em uma startup, a Mozilla.ai, para construir software de código aberto que inicialmente se concentrará no desenvolvimento de ferramentas que cercam motores de IA abertos, como o do Allen Institute, a fim de torná-los mais fáceis de usar, monitorar e implementar.

A Mozilla Foundation, fundada em 2003 para promover a manutenção da internet como um recurso global aberto a todos, preocupa-se com uma maior concentração de poder tecnológico e econômico. "Um pequeno grupo de players, todos na costa oeste dos EUA, está tentando dominar o espaço da IA gerativa antes mesmo de ele realmente começar", disse Mark Surman, presidente da fundação.

US$ 1 bi em desenvolvimento

Farhadi e sua equipe avançaram no tempo tentando controlar os riscos de sua estratégia de abertura. Por exemplo, eles estão trabalhando em maneiras de avaliar o comportamento de um modelo na fase de treinamento e, em seguida, garantir certas ações, como discriminação racial e fabricação de armas biológicas. O especialista considera as grades de proteção dos grandes modelos de chatbot como 'band-aids', que hackers inteligentes podem facilmente arrancar.

"Meu argumento é que não devemos permitir que esse tipo de conhecimento seja codificado nesses modelos", disse Farhadi. As pessoas farão coisas ruins com essa tecnologia, assim como fizeram com todas as tecnologias poderosas, afirma.

Para ele, a tarefa da sociedade é entender e gerenciar melhor os riscos. Neste sentido, diz, a abertura é a melhor aposta para encontrar segurança e compartilhar oportunidades econômicas.

"A regulamentação não resolverá isso por si só", disse Farhadi.

O esforço do Allen Institute enfrenta alguns obstáculos formidáveis. Um dos principais é que construir e melhorar um grande modelo generativo requer muita potência computacional. Farhadi e seus colegas afirmam que as técnicas de software emergentes são mais eficientes. Ainda assim, ele estima que a iniciativa do Allen Institute exigirá US$ 1 bilhão em desenvolvimento nos próximos anos.

O especialista começou a buscar apoio de órgãos governamentais, empresas privadas e filantropos da tecnologia. Mas ele se recusou a dizer se já havia conseguido financiadores.

Se tiver sucesso, o maior teste será criar uma comunidade duradoura para apoiar o projeto.

"É necessário um ecossistema de players abertos para realmente afetar os grandes", disse Surman, da Fundação Mozilla. "E o desafio nesse tipo de jogo é apenas paciência e tenacidade."

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.