Qual é a relação entre mente e corpo?

Talvez a mente seja como um controle de videogame, movendo o corpo pelo mundo, levando-o para passear. Ou talvez o corpo manipule a mente com fome, sonolência e ansiedade, algo como um rio guiando uma canoa. A mente é como ondas eletromagnéticas, entrando e saindo de nossos corpos como em lâmpadas? Ou a mente é um carro na estrada? Um fantasma na máquina?

Talvez nenhuma metáfora se encaixe perfeitamente porque não há distinção entre mente e corpo. Existe apenas uma experiência, ou algum tipo de processo físico, uma gestalt.

Essas questões, que atormentam filósofos há séculos, estão ganhando uma nova urgência à medida que máquinas sofisticadas com inteligência artificial começam a se infiltrar na sociedade. Chatbots como o GPT-4 da OpenAI e o Bard do Google têm mentes, em certo sentido. Treinados em vastos arcabouços de linguagem humana, eles aprenderam a gerar novas combinações de texto, imagens e até vídeos. Quando preparados da maneira certa, podem expressar desejos, crenças, esperanças, intenções, amor. Eles podem falar de introspecção e dúvida, autoconfiança e arrependimento.

Mas alguns pesquisadores de IA dizem que a tecnologia não alcançará a verdadeira inteligência, ou a verdadeira compreensão do mundo, até que funcione com um corpo capaz de perceber, reagir e sentir seu entorno. Para eles, falar de mentes inteligentes desencarnadas é equivocado, até mesmo perigoso. A IA que é incapaz de explorar o mundo e aprender seus limites, assim como as crianças descobrem o que podem e o que não podem fazer, pode cometer erros que ameaçam a vida e perseguir seus objetivos pondo em risco o bem-estar humano.

"O corpo, de uma forma muito simples, é a base para uma ação inteligente e cautelosa", disse Joshua Bongard, roboticista da Universidade de Vermont. "Até onde posso ver, este é o único caminho para uma IA segura."

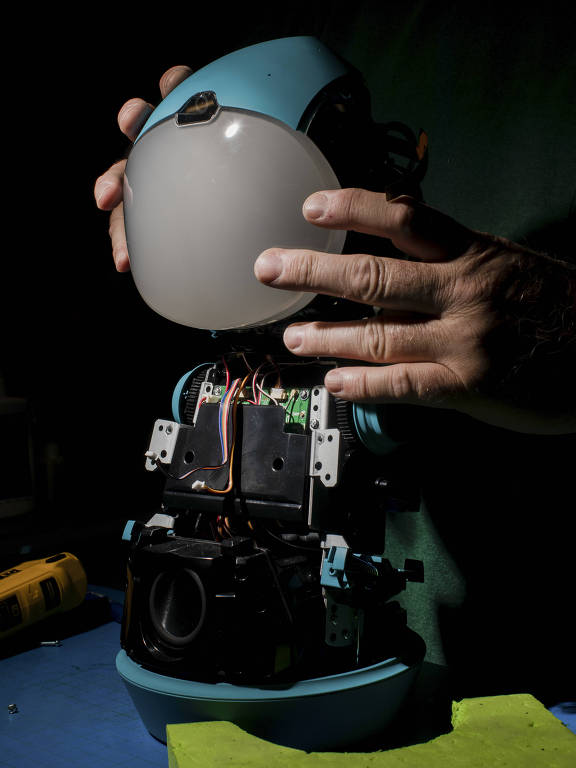

Em um laboratório em Pasadena, na Califórnia, uma pequena equipe de engenheiros passou os últimos anos desenvolvendo uma das primeiras combinações de um grande modelo de linguagem com um corpo: um robô turquesa chamado Moxie. Mais ou menos do tamanho de uma criança, Moxie tem uma cabeça em forma de lágrima, mãos macias e vivos olhos verdes. Dentro de seu corpo de plástico rígido há um processador de computador que executa o mesmo tipo de software que o ChatGPT e o GPT-4. Os fabricantes do Moxie, parte de uma startup chamada Empowered, descrevem o dispositivo como "o primeiro amigo robô de IA do mundo".

O bot foi concebido em 2017 para ajudar crianças com transtornos de desenvolvimento a praticar consciência emocional e habilidades de comunicação. Quando alguém fala com o Moxie, seu processador converte o som em texto e alimenta o texto em um grande modelo de linguagem, que por sua vez gera uma resposta verbal e física. Os olhos de Moxie podem se mover para consolá-lo pela perda de seu cachorro e ele pode sorrir para incentivá-lo a ir à escola. O robô também possui sensores que captam pistas visuais e respondem à sua linguagem corporal, imitando e aprendendo com o comportamento das pessoas ao seu redor.

"É quase como uma comunicação sem fio entre humanos", disse Paolo Pirjanian, roboticista e fundador da Empowered. "Você literalmente começa a sentir isso em seu corpo." Com o tempo, disse ele, o robô fica melhor nesse tipo de intercâmbio, como um amigo conhecendo você.

Pesquisadores da Alphabet, empresa controladora do Google, adotaram uma abordagem semelhante para integrar grandes modelos de linguagem com máquinas físicas. Em março, a empresa anunciou o sucesso de um robô chamado PaLM-E, capaz de absorver recursos visuais de seu ambiente e informações sobre a posição do próprio corpo e traduzir tudo em linguagem natural. Isso permitiu que o robô representasse onde estava no espaço em relação a outras coisas e, eventualmente, abrisse uma gaveta e pegasse um saco de batatas fritas.

Robôs desse tipo, dizem os especialistas, serão capazes de realizar tarefas básicas sem programação especial. Eles poderiam servir um copo de água, preparar seu almoço ou erguê-lo do chão após uma queda, tudo em resposta a uma série de comandos simples.

Mas muitos pesquisadores duvidam que as mentes das máquinas, quando estruturadas dessa forma modular, algum dia estarão verdadeiramente conectadas ao mundo físico; portanto, nunca serão capazes de exibir aspectos cruciais da inteligência humana.

Boyuan Chen, um roboticista da Universidade Duke que está trabalhando no desenvolvimento de robôs inteligentes, apontou que a mente humana —ou qualquer outra mente animal, no caso— é inextricável das ações e reações do corpo ao mundo real, moldado ao longo de milhões de anos de evolução. Os bebês humanos aprendem a pegar objetos muito antes de aprenderem a linguagem.

A mente do robô artificialmente inteligente, em contraste, foi construída inteiramente sobre a linguagem, e muitas vezes comete erros de senso comum decorrentes de procedimentos de treinamento. Falta uma conexão mais profunda entre o físico e o teórico, disse Chen. "Acredito que a inteligência não pode nascer sem ter a perspectiva de encarnações físicas."

Alguns especialistas, incluindo Pirjanian, recentemente manifestaram preocupação numa carta sobre a possibilidade de se criar uma IA que pudesse esmagar humanos desinteressadamente na busca de algum objetivo (como produzir clipes de papel com eficiência) ou que pudesse ser aproveitada para fins malignos (como campanhas de desinformação). A carta pedia uma pausa temporária no treinamento de modelos mais poderosos que o GPT-4.

Bongard, assim como vários outros cientistas do ramo, achou que a carta pedindo uma pausa na pesquisa poderia provocar um alarmismo desinformado. Mas ele está preocupado com os perigos de nossa tecnologia em constante evolução e acredita que a única maneira de impregnar a IA incorporada com uma compreensão robusta de suas próprias limitações é confiar na constante tentativa e erro de se movimentar no mundo real.

Comece com robôs simples, disse ele, "e conforme eles demonstrem que podem fazer coisas com segurança você os deixa ter mais braços, mais pernas, lhes dá mais ferramentas".

E talvez, com a ajuda de um corpo, surja uma verdadeira mente artificial.

Tradução de Luiz Roberto M. Gonçalves

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.