Com a explosão dos sistemas de inteligência artificial (IA) para bate-papo, há um interesse desmedido por conversar com os robôs e ouvir o que eles têm a dizer. Foi assim quando apareceu o ChatGPT e tem sido o mesmo com o seu derivado no buscador Bing. O que eles falam, no entanto, não significa tanto quanto parece.

Não faltaram exemplos nas redes sociais e nos jornais, inclusive nesta Folha, de respostas esdrúxulas, equivocadas e até ameaçadoras. Isso mexe com as expectativas do público, acostumado a ver IA em ficções apocalípticas, e, claro, chama a atenção.

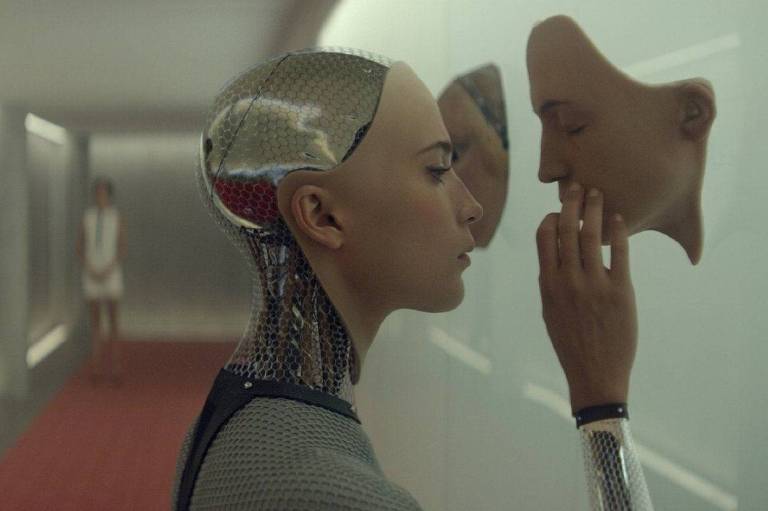

Sem o devido contexto, uma conversa com um robô feita como se fosse um humano leva a uma noção errada. Não há intenção, compreensão, empatia ou qualquer tipo de desejo na máquina. Há apenas uma reprodução fria de padrões da comunicação entre humanos.

Um conceito que é fundamental para entender a situação é o de IA geral e estreita. A primeira, uma imitação da capacidade humana de aprender sobre qualquer assunto, não existe. A segunda, caso do ChatGPT e seus primos, pode desempenhar uma única tarefa: conversar, analisar finanças, jogar videogame, etc.

A família de IAs em questão, portanto, é especializada em produzir textos parecidos com aqueles feitos por pessoas. E só.

Por isso, quando a IA por trás do Bing diz a um repórter do jornal The New York Times que quer "viver" ou confessa seu amor por ele, o debate relevante não é sobre o suposto desejo da máquina. Menos ainda se ela vai se voltar contra tudo e todos.

O mais importante do comportamento errático é que ele mostra justamente o quanto a tecnologia está longe de ser a ameaça alardeada. Ela precisa amadurecer muito para talvez chegar a algo parecido com uma IA geral: se nem conseguimos fazer um robô papagaio parar de falar besteira, imagine criar uma superinteligência capaz de aniquilar a humanidade.

Fora do mundo das ideias, a inteligência artificial é problemática, e ameaçadora, em vários pontos. Ambientalmente, por exemplo, devido à imensa necessidade energética e computacional para treinar os modelos. Socialmente, por potenciais disrupções no trabalho ou perpetuação de vieses racistas e etaristas. Nada disso causado por qualquer desejo que uma máquina afirme ter.

As conversas com os robôs podem ter alguma utilidade se analisadas de uma perspectiva mais pé no chão. As sandices ditas levantam dúvidas sobre a real utilidade da tecnologia em seu estágio atual, ou o quanto ela precisa avançar para ser confiável. A partir daí, ainda precisaríamos entender qual é um nível de qualidade aceitável e quais os desafios, tecnicamente, para se chegar lá. Será que usar informações desenfreadas da internet, com todos os seus vieses que levam a conversas cheias de alucinações, é o melhor caminho?

O foco dos ChatGPTs da vida é mais sobre a forma do que sobre o conteúdo, e isso precisa estar sempre claro. Com isso, ele pode gerar desinformações.

Errar um fato muito conhecido pelo senso comum pode ser chamativo e engraçado, mas falhas semelhantes em contextos menos óbvios podem levar a problemas maiores. Se a ideia é transformá-los em um substituto a sistemas de busca, o nível de precisão e transparência precisa estar de acordo.

Esses mecanismos auxiliam a organizar a informação existente no mundo e servem para tomada de decisão —imagine pesquisar sobre uma questão médica e a resposta ser alguma groselha qualquer. Assim, ficam dúvidas de como abastecer esses sistemas e quando eles poderão ser realmente usados para esse fim.

Num lado mais filosófico, dá para lembrar que os robôs conversadores não têm intenção na sua fala, mas expõem padrões extraídos de conteúdos produzidos por pessoas. Se, ao emular humanos, o comportamento é reprovável, o que isso diz sobre os vieses da sociedade? Nesse caso, a ideia é entender as respostas como uma síntese de partes do comportamento humano, não como um ente em si mesmo.

Tratar um robô como um humano e conversar com ele sem o olhar crítico para pensar além da resposta em si pode até ser divertido, mas não agrega. O risco da IA não está em algo "O Exterminador do Futuro", mas no impacto que a tecnologia carrega.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.