O Google passou a entregar respostas geradas por inteligência artificial na busca para quem ativa uma opção de teste. O texto aparece em um lugar de destaque, antes de qualquer link de portais de notícias.

O modelo, chamado por especialistas e entidades representativas dos jornais ouvidos pela Folha de prática anticompetitiva, retira visibilidade dos veículos que apuraram a notícia e se adaptaram por anos à disputa pelo primeiro lugar na lista de resultados entregue na página mais visitada da internet. Além disso, afirmam, pode contribuir para o ruído no debate público e aumentar a desinformação.

A fase de testes vai até maio de 2024, de acordo com a página do Google. A empresa faz alerta de que a IA generativa é experimental e a qualidade e a disponibilidade das respostas pode variar.

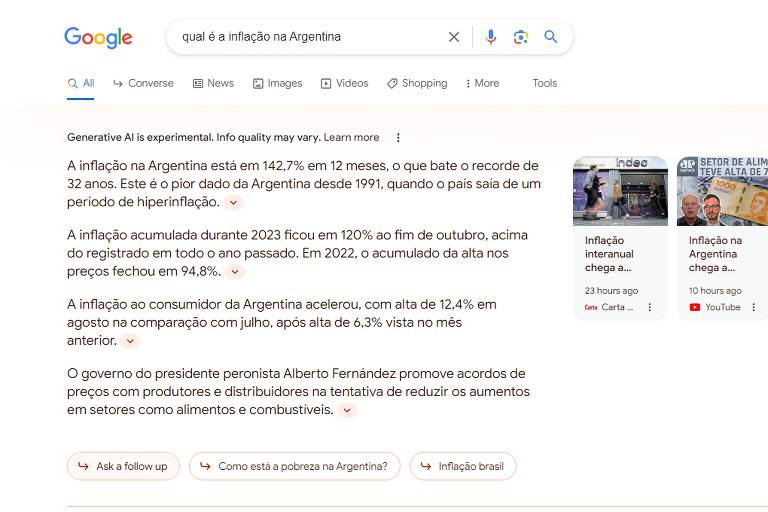

O gigante das buscas diz que apresenta quais foram as fontes de informação usadas, diferentemente do concorrente ChatGPT. Apesar disso, mostra em destaque o texto gerado por IA e apresenta links de referência com fonte menor, à direita da resposta.

Ao sumarizar as reportagens, a resposta gerada por IA reduz o incentivo para que as pessoas acessem o website indicado como referência, de acordo com o professor de economia da Universidade de Houston Haaris Mateen. Ele é um dos autores recentes de estudo que estima a dívida do Google e do Facebook com os jornais americanos.

"Entregar aos usuários os pontos mais importantes da matéria torna o conteúdo original menos interessante. Isso reduz ainda mais as chances dos veículos noticiosos de fazer dinheiro a partir do conteúdo que produzem e publicam", avalia Mateen. Outro risco é afastar o leitor de discussões mais complexas.

O Google ainda não informa se se responsabiliza pelas respostas geradas pelo seu modelo de inteligência artificial, como fazem os jornais. No caso da plataforma de IA Bard, apenas diz que as respostas podem ser imprecisas.

A advogada e coordenadora do Creative Commons Brasil, Alice Lana, afirma que o Google já faz a mediação na relação entre as pessoas e a informação ao ordenar quais páginas prioriza. "Com a IA, veremos um aprofundamento dessa mediação, porque não vai ser nem o texto escrito por alguém, mas a própria IA vai gerar esse texto." Assim, a discussão sobre responsabilidade das plataformas ganha um novo tópico.

A Folha testou o recurso, que entrega informações recentes do noticiário. Consegue responder, por exemplo, qual a inflação na Argentina durante o mês de outubro. Para isso, usou informações de O Estado de S. Paulo, protegida por paywall, e do UOL.

A reportagem da Folha que aparecia na primeira colocação na busca comum não foi citada como fonte.

Em nota, o Google Brasil afirma que "continua a priorizar abordagens que enviem tráfego para os sites de um amplo número de criadores de conteúdo, incluindo veículos de comunicação, para continuar a promover uma web saudável e aberta."

O Google ainda não divulgou meios para sites noticiosos protegerem seus dados, se não quiserem disponibilizar informações para treinar os modelos de inteligência da empresa de tecnologia. Disse, no entanto, que trabalha para desenvolver novos protocolos legíveis por máquina para dar aos editores da web escolha e controle sobre como seu conteúdo da web é usado para IA e pesquisa.

No caso do ChatGPT, a desenvoledora OpenAI publicou instruções para os criadores resguardarem suas publicações.

Os sites podem adicionar ao seu código fonte um arquivo chamado "robot.txt", com instruções para os robôs do Google e de outros sites de busca ignorarem o conteúdo publicado em determinado endereço. Essa solução, contudo, joga o link em uma espécie de limbo da web, já que deixa de aparecer em buscas.

A Justiça, por exemplo, recorre a essa medida para apagar um dado histórico danoso a alguém, em países onde há o chamado direito ao esquecimento.

Nos EUA, o recurso funciona desde agosto, e grandes veículos de imprensa já se pronunciaram dizendo que não querem que a empresa se aproprie de dados sem autorização. Foi o caso de New York Times e Washington Post, os jornais com mais assinaturas digitais no mundo. Segundo o Washington Post, mais de 500 jornais bloquearam os bots do ChatGPT.

Com isso, no caso do Google, haveria outro efeito colateral: esses sites deixariam de aparecer entre os links citados como referência pela resposta de IA do Google.

Para o presidente da entidade patronal ANJ (Associação Nacional de Jornais), Marcelo Rech, o novo recurso do Google é extremamente preocupante. "Pelos testes até agora, a fonte da informação fica oculta em uma aba, que precisa ser acionada pelo usuário. Há uma evidente tentativa de se reduzir a visibilidade dos links, cortando ainda mais o tráfego para os veículos."

"Essa iniciativa faz parte da estratégia das big techs de criarem internets em si mesmas, com o objetivo de manter o usuário dentro de seu próprio ecossistema, engajando-se assim cada vez mais com seus anúncios", afirma Rech.

"Infelizmente, isso é feito à custa do estímulo à pluralidade e do tráfego de veículos jornalísticos, o que só confirma a vocação monopolista das big techs e a necessidade de uma regulamentação que reequilibre as forças presentes no mundo digital", acrescenta.

À Folha a presidente da Fenaj (Federação Nacional de Jornalistas), Samira Castro, diz que fazer um compilado de informações sem se responsabilizar, de certa forma, pode gerar alguma forma de desinformação. "Por isso, há de se pensar em regulamentação da tecnologia."

Para Castro, as respostas geradas por IA invisibilizam o trabalho do jornalista, que tem sua produção usada para treinar os modelos de linguagem como Bard, do Google, e ChatGPT. "É necessário proteger a produção de notícias desse uso usurpado. Fazer jornalismo custa caro."

O Google afirma que vai priorizar estratégias de remuneração dos veículos, à medida que experimenta novos recursos alimentados por IA em seus produtos.

A novidade chega ao público em meio às discussões sobre o dever das big techs financiarem a produção de notícias. O serviço de busca do Google e a rede social Facebook devem entre US$ 11,9 bilhões e US$ 13,9 bilhões apenas aos veículos noticiosos dos Estados Unidos, segundo estimativas de instituto ligado à Universidade de Columbia.

Em nota enviada à reportagem, o Google rejeita os dados apresentados no relatório e a metodologia. "Menos de 2% de todas as buscas são relacionadas a notícias", afirmou sua assessoria. Ainda acrescentou que a plataforma gera "um enorme valor para os veículos noticiosos, enviando mais de 24 bilhões de visitantes para seus sites –sem qualquer custo para eles– que eles podem monetizar".

Não há estudo similar no Brasil. O Congresso Nacional discute a possibilidade de empresas de tecnologia pagarem para veicular notícias, visto que as pessoas consomem e repercutem reportagens nessas plataformas. Esse trecho foi retirado do PL das Fake News e tramita em novo texto.

Canadá e Austrália aprovaram projetos análogos, mas passam por situações opostas. A Austrália deixou brecha para big techs negociarem diretamente com os jornais, e as empresas têm fechado acordos. No Canadá, a definição ficou por conta da lei e Facebook e Google responderam com boicotes —bloquearam a circulação de notícias.

Neste meio-tempo, o Google segue a implementação de seus recursos de IA. Afirmou que deve levar a experiência de IA generativa a partir desta semana, de forma gradual, ao seu aplicativo disponível em Android e iPhone.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.