[RESUMO] Enquanto grandes potências aceleram o desenvolvimento de inteligência artificial aplicada a usos militares, as Nações Unidas procuram manter o elemento humano na equação.

“Um pouco mais à direita e você tem o objeto iluminado. Agora é a hora da decisão, mas um dia tudo será automático. É inevitável”, diz Ariel, nome fictício de um operador real de drones das Forças de Defesa de Israel.

Ele demonstrava à reportagem um simulador deste cada vez mais comum tipo de aeronave, com um desassombro notável sobre o quanto estaria disposto a abrir mão no processo decisório de combate.

“Iluminado”, no caso, é o jargão da detecção do alvo —ou “objeto”, na novilíngua eufemística utilizada. Na vida real, algum comboio do grupo fundamentalista Hizbullah na Síria ou o transporte de armas para o Hamas na Faixa de Gaza.

O que mais intriga, porém, é a inevitabilidade citada pelo operador. Se hoje a lei internacional já não alcança gente como Ariel, inimputável por operar sob o escudo da distância e da impessoalidade, como será se for dado às máquinas o poder de decidir sobre a vida ou a morte de inimigos?

Essa água já moveu muito o moinho da ficção científica, e “O Exterminador do Futuro” é ainda hoje seu exemplo mais vistoso. A série de filmes, cujos dois primeiros episódios (1984 e 1991) são clássicos absolutos do gênero, voltará aos cinemas este ano, com produção do criador dos originais, James Cameron.

Neles, a singularidade, o momento em que a inteligência artificial se torna consciente, ganha tons apocalípticos na forma da rede Skynet. Uma guerra nuclear começa porque as máquinas acham por bem se livrar dos humanos, potencialmente seus maiores inimigos.

O mote foi repetido com variações ao longo do tempo, como na trilogia “Matrix” (das hoje irmãs Wachowski), que também vai ganhar um novo episódio em 2022. Quase invariavelmente, adicionam-se à ideia pitadas de malthusianismo —muito atrativas num tempo de desalento político mundial e crise ambiental.

Esse risco existencial associado à singularidade era temor central para o físico britânico Stephen Hawking, morto em 2018, que passou seus últimos anos alertando sobre o tema.

Não chegamos a tal ponto ainda, mas estamos perto o suficiente para que a ONU (Organização das Nações Unidas) tenha promovido sua terceira reunião anual sobre a questão.

Há até um fórum próprio, composto por 89 países (incluindo o Brasil), para discutir o assunto. Ganhou um nome que é piada pronta sobre a inteligência da burocracia dos diplomatas: Convenção sobre Proibições ou Restrições ao Uso de Algumas Armas Convencionais que Possam Ser Consideradas Excessivamente Perigosas ou Ter Efeitos Indiscriminados.

O foco dos trabalhos deste ano, realizados na semana retrasada em Genebra, foi tentar modular princípios éticos e humanitários para o desenvolvimento de armas inteligentes.

Se dependesse do secretário-geral das Nações Unidas, o português António Guterres, elas seriam proibidas. Todavia, os países interessados nos novos armamentos —EUA, Rússia e China à frente— são signatários da convenção e barraram tais intenções. Do encontro saíram, então, 11 princípios que devem orientar a pesquisa e fabricação desses candidatos a Arnold Schwarzenegger em versão robô.

“A Lei Humanitária Internacional é aplicável a todos os sistemas de armas, incluindo o potencial desenvolvimento e uso de armamentos letais autônomos”, diz o primeiro item.

“A responsabilidade humana pela decisão do uso de sistemas de armas deve ser mantida, dado que a prestação de contas não pode ser transferida para máquinas. Isso precisa ser considerado durante todo o ciclo de vida do armamento”, completa o segundo princípio da ONU.

Se a linha geral está ali, ecos mais próximos à ficção podem ser vistos na antepenúltima recomendação: “As tecnologias emergentes na área de sistemas de armas letais autônomos não devem ser antropomorfizadas”.

É um temor que remete à reverência religiosa do Ocidente com a dita face de Deus: desde Charles Darwin é delicado brincar com a representação do que é humano, vide as críticas que o britânico recebeu (e recebe até hoje em círculos criacionistas) por associar o homem a macacos.

Ou seja, nada de “I’ll be back”, como faria o T-800 de Schwarzenegger. Ou alguma aplicação bélica para as sedutoras e letais robôs do longa “Ex Machina” (Alex Garland, 2014), talvez o melhor da safra mais recente do gênero, ou da série russa “Melhor que Nós” (Alexander Kessel, 2019), que estreou neste mês na Netflix.

Por ora, a diretriz vem sendo seguida. O país que mais tem empregado robôs militares, a Rússia, não tem nenhum humanoide no catálogo —até porque seria impraticável para carregar os canhões e metralhadoras ora em uso.

De todo modo, ali não se vê ainda indício de inteligência artificial em uso, e sim armas por controle remoto com algum grau de automação.

Nesse campo, os russos estão atrás, segundo especialistas, de americanos e chineses. Os três países, contudo, possuem em diversos estágios de desenvolvimento drones de combate. Hoje, todos são do modelo “loyal wingman”, ou seja, acompanham os desígnios de um piloto de caça que serve de líder do esquadrão.

Um filme bem vulgar, “Stealth” (Rob Cohen, 2005), já lidava com o conceito —obviamente tudo dava errado quando o robô enlouquecia.

Única dessas potências a divulgar números, os Estados Unidos querem investir US$ 3,7 bilhões em armas autônomas e US$ 1 bilhão em inteligência artificial no próximo ano. Alguns programas, como o de drones navais, tiveram um pedido de aumento de orçamento decuplicado.

Se não parece muito no cômputo geral de gastos militares de Washington, de quase US$ 700 bilhões, é uma fatia superior a tudo o que o Brasil tem para armamentos neste ano.

EUA e Rússia lançaram recentemente diretrizes para o uso de inteligência artificial aplicada a armas. A versão americana, detalhada, cita “aumentar o poder decisório em combate”, sem nunca tirar o elemento humano da equação.

As preocupações da ONU, contudo, não são infundadas. Os primeiros estudos sobre inteligência artificial, termo criado pelo pesquisador americano John McCarthy em 1956, já ensejavam a ideia da criação de uma mente autônoma e consciente.

O tema permeava pesquisas na primeira metade do século 20. Em 1943, a dupla americana Warren Sturgis McCulloch e Walter Pitts publicou “Um Cálculo Lógico das Ideias Imanentes na Atividade Nervosa”, pedra fundamental das chamadas redes neurais, que virariam a máquina Perceptor em 1958.

O ano de 1950, todavia, é o que marca o cruzamento da ciência e da ética que tanto perturba os diplomatas de hoje.

Nele, o pai da computação, o britânico Alan Turing, criou o teste que leva seu nome, que basicamente busca estabelecer o grau de inteligência individual de máquinas —qualquer semelhança com Rachael (Sean Young) sendo inquirida por Deckard (Harrison Ford) em “Blade Runner” (Ridley Scott, 1982) ou com o enredo central do supracitado “Ex Machina” não é coincidência.

Aquele ano também viu o lançamento da coleção “Eu, Robô”, do americano Isaac Asimov. Lá foram expostas, colhidas de um conto obscuro de 1942, as três leis da robótica: 1) Um robô não pode machucar um ser humano ou, por inação, permitir que um humano se machuque; 2) Um robô deve obedecer ordens dadas por humanos, exceto quando elas entram em conflito com a primeira lei; 3) Um robô deve proteger sua própria existência desde que tal proteção não entre em conflito com a primeira e a segunda lei.

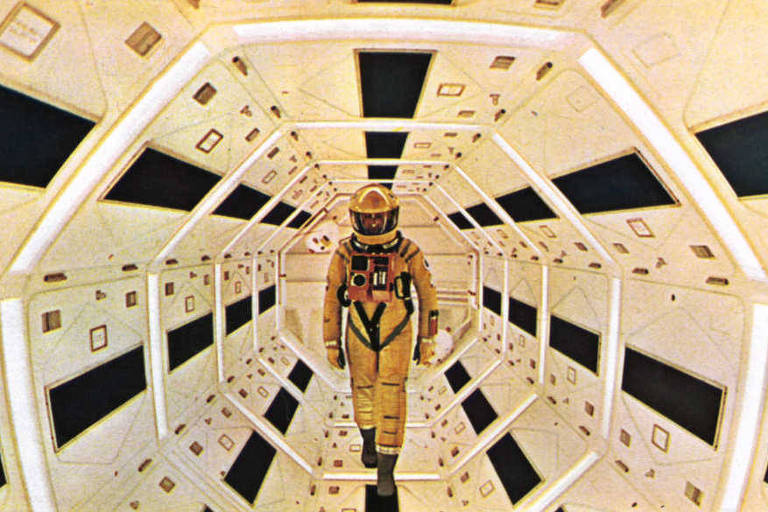

As contradições filosóficas evidentes para os seres conscientes balizaram boa parte das especulações ficcionais da segunda metade do século 20 para cá. Do HAL-9000 de “2001 - Uma Odisseia no Espaço” (Stanley Kubrick, 1968) ao Sonny de “Eu, Robô” (Alex Proyas, 2004), há um catálogo de mentes artificiais em conflito com sua natureza, que, de todo modo, busca espelhar o humano.

O paradoxo, evidenciado pela imposição da ONU de supervisão humana para armas autônomas, leva o debate para a teologia: se o homem, como o Deus do monoteísmo, tem poder de criar, como lidar com os aspectos mais sombrios do livre-arbítrio dado à sua criação? O conflito se insinua inevitável.

Naturalmente, todas essas implicações ainda dependem de um salto: a singularidade. Quando o computador da IBM Deep Blue chocou o mundo e derrotou o campeão mundial de xadrez Garry Kasparov, em 1997, ele estava apenas aplicando, com altíssima velocidade, as inúmeras possibilidades do jogo.

Ele fora ensinado a isso, um estágio ainda não superado. Quando surgem notícias de empresas admitindo que nossos celulares e dispositivos eletrônicos estão gravando humanos o tempo todo, algo bem explorado em “Ex Machina”, a apavorante possibilidade ainda parece um processo sob domínio humano.

Há especialistas que não acreditam que a independência das máquinas chegará, pela infinita complexidade adaptativa do cérebro humano. Se neurocientistas não conseguem exprimir a totalidade do processamento do córtex, como fazer algo melhor do que a mímica virtual dela?

Já futurologistas de renome, como Ray Kurzweil, Patrick Winston e Jürgen Schmidhuber, são mais assertivos e creem na inevitabilidade da singularidade —dizem que o dia chegará em qualquer momento entre 2030 e 2050. Muito dependerá da velocidade de conexão, o que nos leva à guerra entre China e EUA pelo predomínio das bandas de 5G, essenciais para a tarefa.

Apesar da preocupação da ONU, talvez não sejam laboratórios militares geridos por governos os que mais se aproximam da Skynet.

Gigantes com acesso a grandes bases de dados humanos, como Google e Facebook, trabalham diuturnamente sobre o tema. É o dinheiro, estúpido, parafraseando o marqueteiro americano James Carville.

Assim, parece haver chance razoável de um painel das Nações Unidas ainda estar discutindo se o robô matador pode ou não ter dois braços no momento em que a singularidade estiver à porta, com efeitos insondáveis para a evolução humana.

Igor Gielow é repórter especial da Folha, onde trabalha desde 1992. Foi secretário de Redação e diretor da Sucursal de Brasília do jornal e é autor do romance “Ariana” (ed. Record).

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.