[resumo] Uso de novas tecnologias de combate ao crime prolifera no Brasil como promessa de eficiência, contudo ferramentas de reconhecimento facial e de previsão de delitos podem minar liberdades civis e estimular discriminação se mal administradas.

O governador ultraconservador do Rio de Janeiro, Wilson Witzel (PSC), foi eleito em 2018 com um discurso de campanha linha-dura contra o crime. Ele compartilha o desejo de exterminar bandidos com seu ex-aliado, o presidente Jair Bolsonaro (sem partido), que uma vez disse que criminosos deveriam morrer nas ruas como baratas.

Para não ficar atrás, Witzel prometeu “abater” e “cavar túmulos” para os criminosos. E não perdeu tempo. Depois de aumentar drasticamente as operações policiais pesadas, as mortes de civis aumentaram. As polícias civil e militar do Rio mataram pelo menos 1.810 pessoas em 2019, o número mais alto desde o início da apuração desses registros, em 1998.

Uma das primeiras ações de Witzel foi intensificar o uso da tecnologia para cumprir suas promessas de redução do crime. Inicialmente ele visitou Israel, interessado em drones equipados com rifles de precisão que tornariam possível atirar em qualquer um que estivesse portando uma arma.

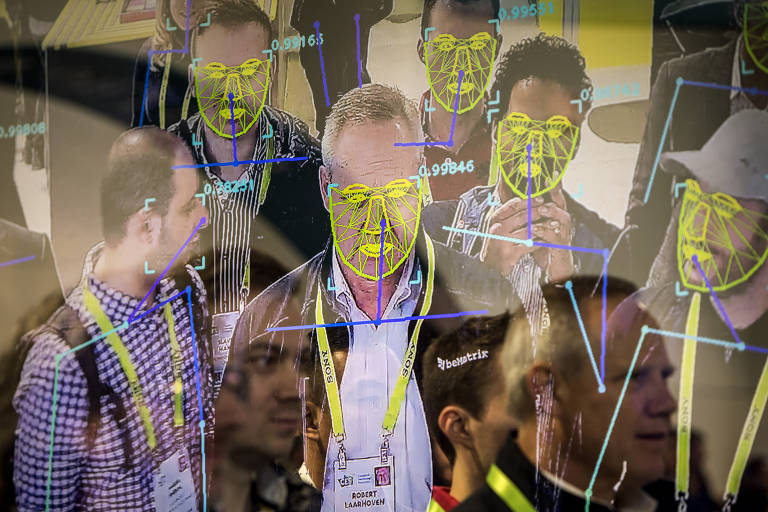

Quando seu plano fracassou, ele colocou 120 atiradores de elite em helicópteros, pedindo a eles para “mirar na cabecinha” de bandidos. Witzel também prometeu instalar 30 mil novas câmeras para ler rostos e placas de carros, embora esse programa de vigilância ainda não tenha decolado completamente. Enquanto isso, o governador equipou um grupo de “unidades de polícia pacificadora” com câmeras corporais conectadas a tecnologias de reconhecimento facial.

Witzel não é o único político a testar novas tecnologias de segurança. No início dos anos 2000, São Paulo foi o primeiro estado a digitalizar estatísticas criminais e implantar softwares de mapeamento, incluindo o InfoCrime e o Detecta. Essas e outras medidas costumam ser relacionadas a uma queda significativa nos índices criminais do estado.

Em 2017, as autoridades de São Paulo lançaram o projeto City Cameras, destinado a integrar mais de 10 mil câmeras públicas e privadas nos sistemas de vigilância da polícia estadual e da Guarda Civil Metropolitana. Ao redor de todo o Brasil há sinais de autoridades erguendo muralhas digitais: câmeras alinhando as principais vias de acesso rodoviárias para rastrear placas de carros.

Além disso, pelo menos cinco forças policiais estaduais lançaram projetos-piloto de reconhecimento facial, alegando ter prendido pelo menos 151 pessoas em 2019 por meio desse método.

As agências policiais brasileiras passaram a explorar nos últimos anos uma série de novas tecnologias. Por exemplo, a Polícia Federal esteve entre as primeiras agências do mundo a implantar drones militares fabricados por Israel. Outras forças policiais estaduais também adotam recursos de previsão de crimes, que combinam “machine learning” e grandes conjuntos de dados para estimar a probabilidade de incidentes. Embora sujeitas a muitas críticas e longe de serem perfeitas, ferramentas preditivas, apontam algumas pesquisas, podem ajudar a melhorar a eficácia e a eficiência do policiamento. Programas pilotos desse tipo já estão em andamento no Rio de Janeiro, em Fortaleza e Santa Catarina.

Assim, não é surpresa que organizações defensoras de liberdades civis tenham muitos motivos para preocupação com o uso entusiasmado desses novos recursos. Essas organizações sabem que as empresas fornecedoras de tecnologias de reconhecimento facial e de previsão criminal geralmente exageram as vantagens e diminuem os riscos. E mais grave ainda, os fornecedores raramente divulgam evidências científicas concretas dos impactos de seus produtos.

De qualquer forma, se adotadas, as plataformas de reconhecimento facial e previsão de crime deveriam vir com um alerta. A qualidade de sua performance normalmente está limitada aos dados que as alimentam e às formas com que são gerenciadas.

Por exemplo, a precisão algorítmica das plataformas de reconhecimento facial depende dos bancos de dados usados para treiná-las. Se alimentadas com uma base de imagens homogêneas, serão grandes as chances de falsos negativos ou, ainda pior, de falsos positivos.

A pesquisadora do MIT Joy Buolamwini mostrou como os sistemas de reconhecimento facial registram taxas de erro de 34,7% para mulheres negras, em comparação com apenas 0,8% em homens brancos. Em países como o Brasil, nos quais 64% da população prisional é negra, existe um risco real de que esses métodos deem muito errado.

Ferramentas de previsão do crime e reconhecimento facial podem ser altamente invasivas e minar liberdades civis, quando mal implementadas ou mal-administradas. Algumas dessas ferramentas são ainda mais problemáticas do que outras. Predições criminais baseadas em locais funcionam a partir de estimativas de probabilidade e de risco de crimes em um horário e local específicos.

Já as previsões baseadas em pessoas recorrem a uma ampla gama de dados públicos e pessoais de indivíduos para inferir o risco de uma pessoa perpetrar um crime ou ser uma vítima (ou os dois). Algumas delas dependem de informações pessoais altamente sensíveis. Entretanto, poucas empresas estão inclinadas a divulgar informações sobre como suas ferramentas funcionam.

Por sorte, existem maneiras de limitar vieses e melhorar a responsabilidade e a transparência do uso dessas tecnologias de segurança. No mínimo, todas as empresas deveriam testar seus algoritmos quanto à imparcialidade e discriminação. Isso significa modelar estatisticamente os efeitos diretos e indiretos das fórmulas matemáticas para determinar seus efeitos em certos grupos, de acordo com raça, renda, gênero ou idade.

Se desenvolvidas e utilizadas com diligência e cuidado, as novas tecnologias podem obter melhorias na eficácia e na eficiência da segurança pública. Um estudo recente da McKinsey constatou que a implantação inteligente de instrumentos orientados por dados pode ajudar a reduzir mortes em até 10% e crimes em até aproximadamente 40%, além de diminuir drasticamente os tempos de respostas a emergências.

Para isso, contudo, não basta apenas implementar ferramentas de reconhecimento facial ou de previsão criminal. Necessita-se de uma orientação clara sobre como essas ferramentas serão usadas, assim como treinamento regular na administração, salvaguardas legais e éticas para limitar o uso indevido e testes constantes para garantir a qualidade dos resultados. Custos e benefícios das ferramentas de segurança precisam ser objeto de debate público.

No Brasil, o Instituto Igarapé projetou e testou várias tecnologias, incluindo aplicativos de celulares para policiamento e previsão criminal. O instituto realizou experimentos de controle aleatorizado para medir os impactos estatísticos sobre a eficácia da polícia, a segurança do cidadão e os custos gerais. Novas tecnologias para segurança pública também podem gerar importantes economias, caso implantadas de maneira inteligente.

O ponto é que, embora amplamente implementadas no Brasil e na América Latina, as tecnologias de segurança pública devem ser cuidadosamente administradas e avaliadas. Caso haja evidências de que possam ser efetivas e administradas de maneira responsável, as autoridades públicas devem, sim, considerar sua utilização.

Isso, contudo, deve ser feito de forma transparente, com debate público. Qualquer implementação sem supervisão pode gerar efeitos contraprodutivos. Garantias para a proteção de dados e estratégias para mensurar impactos, sempre acompanhadas de especialistas independentes, não são meros opcionais, mas sim fundamentais para seu sucesso.

)

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.