[RESUMO] Para lidar com a caixa de Pandora da inteligência artificial, aberta recentemente, é preciso estabelecer contornos precisos para balizar o desenvolvimento da nova tecnologia, o que permitiria equilibrar, argumenta o autor, a liberdade de desenvolvimento das big techs e a regulação estatal e evitar que a ferramenta agrave as desigualdades sociais e a pobreza.

Conta o New York Times, em reportagem publicada no início deste mês, que, em 2015, Elon Musk, o controverso dono de X, Tesla e Space X, e Larry Page, o mitológico cofundador do Google, engataram um acalorado debate sobre o futuro da inteligência artificial.

Eles estavam na Califórnia, era aniversário de Musk, e os dois se confrontaram, na frente de convidados, sobre os rumos da nova tecnologia. Musk, segundo relatos, via na IA uma ameaça à humanidade, enquanto Page alimentava uma visão utópica das potencialidades da nova fronteira computacional.

Passados oito anos do encontro e dezenas de bilhões de dólares investidos, a IA se tornou o centro do debate no mundo, e a polêmica dos empresários americanos que ajudaram a moldar a economia global tal qual a conhecemos hoje segue mais viva que nunca.

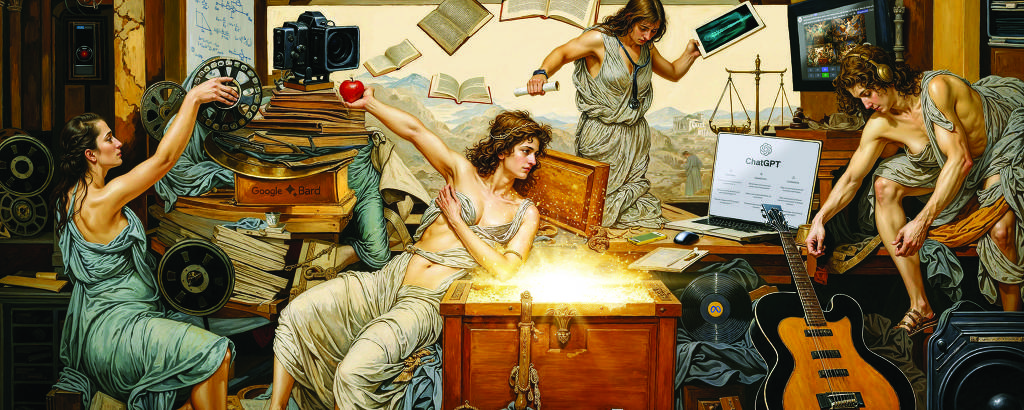

A discussão, na verdade, remonta à década de 1950, quando os primeiros sistemas capazes de realizar tarefas sozinhos foram desenvolvidos. Porém, apenas recentemente, com os avanços da capacidade de aprendizado de máquina e a evolução da ciência de processamento de dados, a caixa de Pandora da IA foi realmente aberta, trazendo um conjunto de ameaças que assombram, ao mesmo tempo que coloca em marcha uma série de transformações que podem trazer grandes benefícios para a humanidade.

O fato certo é que, assim como na mitologia grega, a caixa de Pandora da IA não irá mais se fechar, o que exige definição precisa dos contornos do desenvolvimento da nova tecnologia, de seu uso e dos limites éticos e regulatórios que irão pautar os investimentos em plataformas do gênero daqui por diante.

O mundo melhor imaginado por Page só será alcançado se a sociedade contemporânea encontrar o equilíbrio entre a regulamentação e a necessária liberdade de desenvolvimento das big techs, para que a IA não perpetue nem agrave a pobreza, o desemprego e as mazelas sociais que castigam o mundo. Esse esforço envolve as empresas, o poder público, a academia e toda a sociedade.

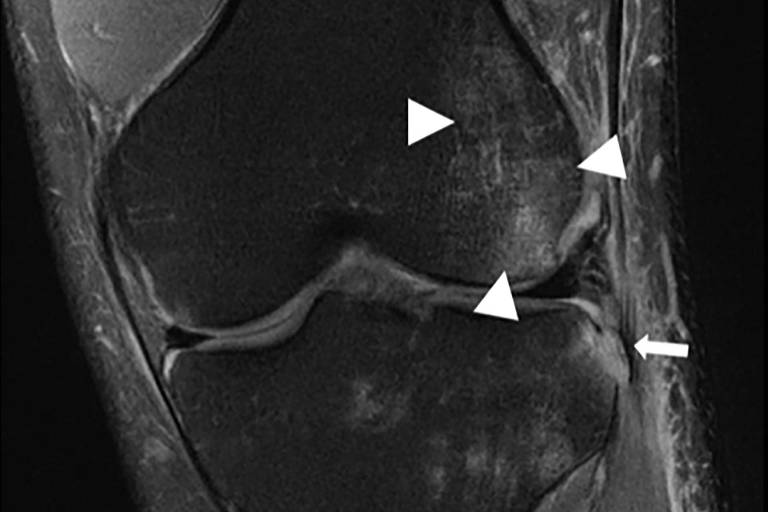

Os impactos positivos da IA são evidentes em todas as áreas do conhecimento. A saúde é um dos campos mais promissores para a nova tecnologia, que começa a contribuir substancialmente no apoio aos profissionais, na melhoria da precisão de diagnósticos através de algoritmos de imagem, na personalização de tratamentos com base em análises preditivas e no desenvolvimento de drogas com o auxílio de modelagem molecular avançada.

A IA também contribui para otimizar fluxos de trabalho hospitalares e facilita o monitoramento remoto de pacientes. Isso tudo, se levado ao sistema público em escala, pode promover um salto no atendimento, na diminuição dos custos e, sobretudo, na qualidade do serviço de saúde oferecido à população.

No campo da sustentabilidade e dos desafios da crise climática, a IA —embora contraditoriamente seja ela mesma uma alta consumidora de energia— também já desponta como candidata a ser o VAR das disputas globais e a Meca da análise de dados e da identificação de soluções para a descarbonização da economia.

A própria ONU, em parceria com a Microsoft, anunciou recentemente o lançamento de uma nova plataforma de IA que irá medir e analisar a emissão de combustíveis fósseis, permitindo o rastreio de países que não estão cumprindo suas promessas de redução.

No campo jurídico, igualmente vemos iniciativas relevantes surgirem, como a do presidente do STF, Luís Roberto Barroso, que se reuniu com representantes de grandes empresas de tecnologia para solicitar, entre outras ações, uma interface que harmonize os sistemas judiciais eletrônicos de todos os tribunais do país.

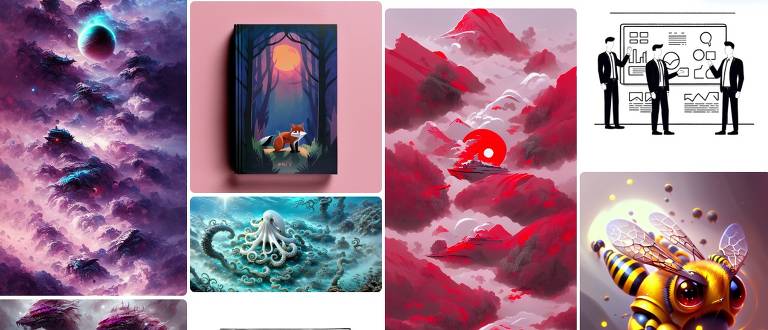

Em sua modalidade generativa, que cria novos conteúdos como imagens, vídeos, áudios, histórias e conversas, as possibilidades no campo da cultura também se expandem exponencialmente. Aqui, a IA está sendo utilizada para compor músicas, criar obras de arte e até desenvolver roteiros de filmes, desafiando e adicionalmente distorcendo as noções clássicas de criatividade e autoria.

A IA pode ter um papel destacado, ainda, no apoio ao diagnóstico e à conservação do patrimônio cultural, com algoritmos que ajudam a analisar e restaurar com precisão obras de arte, além de criar tours personalizados em museus e galerias, auxiliar na digitalização e catalogação de grandes coleções de arte e artefatos culturais, tornando-os mais acessíveis ao público e pesquisadores por meio de arquivos online e exposições imersivas, entre outras aplicações.

Na educação, por sua vez, os avanços também são espetaculares. A tecnologia começa a ser utilizada para analisar grandes volumes de dados, permitindo que pesquisadores e formuladores de políticas compreendam melhor as tendências e os resultados do aprendizado que influenciam suas decisões e práticas.

A ferramenta, no suporte aos profissionais de educação, também pode ajudar a adaptar materiais de ensino, apoiar o desenvolvimento de aulas em maior consonância com a BNCC (Base Nacional Comum Curricular), assim como implementar conteúdos mais precisos que atendam às necessidades de aprendizagem de cada aluno, identificando lacunas e proporcionando uma experiência personalizada da jornada educacional. Com isso, pode oferecer aos professores e profissionais de educação um assistente pessoal e, para os alunos, um tutor individual, algo que só a IA poderá fazer com efetividade em escala.

O fato é que, nesse território, a IA pode tanto aprofundar a desigualdade educacional quanto criar espaços de equidade. Ela será uma aliada poderosa se estiver a serviço de uma intencionalidade pedagógica que aponte para a formação do futuro e que prepare a escola, os profissionais da educação, os alunos e as famílias para o benefício e a participação nesses avanços tecnológicos.

Além disso, segundo a OCDE, temos que garantir o desenvolvimento de competências sociais e emocionais, como a capacidade de se adaptar a mudanças, ser criativo e trabalhar colaborativamente. Essas habilidades e competências serão centrais para que sigamos usando a tecnologia e não sejamos usados por ela, tendo como objetivo o desenvolvimento integral dos indivíduos e a inclusão produtiva, em um mundo no qual principalmente os empregos monótonos e repetitivos serão gradualmente substituídos pela IA.

Ainda sobre os desafios de participarmos do mundo da transformação digital, é certo que a matemática é um pressuposto. Os dados do Pisa (Programa Internacional de Avaliação de Estudantes) são preocupantes, pois somente 3 em cada 10 alunos alcançam no Brasil o nível básico de proficiência na matéria (nível 2), enquanto o índice na OCDE é de 7 em cada 10.

A utilização da IA —com a gamificação e a tutoria individualizada, por exemplo— pode ser um caminho para reduzir essa lacuna e capacitar os jovens nessa disciplina essencial para o raciocínio lógico e o desenvolvimento integral. Importante ressaltar que há múltiplos desafios para essa implementação, entre eles o fato de que apenas 58% das escolas no Brasil têm computador e internet para alunos, segundo dados da pesquisa TIC Educação 2022.

Os avanços positivos da IA, não devemos nos enganar, vêm acompanhados de riscos que podem, no limite, chegar a comprometer o nosso futuro, como o Musk de 2015 e a ficção gostam de lembrar. HAL 9000, o poderoso supercomputador de "2001: Uma Odisseia no Espaço" (1968), o icônico filme de Stanley Kubrick, que entra em confronto com a tripulação da nave a que deveria servir, é uma imagem eloquente que ilustra o debate atual.

O receio que ronda a história da IA desde suas origens, dividindo o meio científico e a sociedade entre otimistas e pessimistas, é uma realidade que se impõe. A corrida por investimentos e lucros acabou ofuscando as discussões éticas primordiais, e o que muitos achavam que deveria ser uma tecnologia colaborativa passou a ser território dominado pelas big techs.

Geoffrey Hinton, um dos pioneiros da inteligência artificial que deixou seu cargo no Google, tem manifestado preocupações sobre os perigos da IA, destacando sua capacidade de superar os humanos no processamento de grandes quantidades de dados e na identificação de tendências invisíveis para nós. Ele ressalta a necessidade de regulamentação diante da rapidez com que os novos sistemas estão sendo introduzidos no mercado, levantando preocupações sobre segurança e eficácia, além das implicações éticas e sociais da tecnologia.

Hoje, o sucesso ou a ruína da IA depende, fundamentalmente, de acordos multilaterais entre as nações, leis nacionais sólidas, agências reguladoras articuladas e recursos disponíveis para que centros de pesquisa públicos e universidades possam participar da corrida tecnológica, criando as condições que garantam a distribuição saudável dos benefícios da nova tecnologia. Essa é uma pauta que o Brasil bem poderia capitanear agora que o país assumiu sua inédita presidência do G20.

Essa regulamentação deve estabelecer um equilíbrio entre a proibição de mau uso da IA e a garantia da transparência aos usuários com a preservação do espaço de empreendedorismo e inovação da iniciativa privada. Deve antecipar também o impacto da tecnologia no mercado de trabalho para evitar que as desigualdades sociais se aprofundem. Deve, ainda, antever os riscos da IA generativa na produção de conteúdos falsos, na reprodução de estereótipos e discriminação raciais e de gênero, na fragilização dos direitos autorais e no pagamento de royalties.

Após um ano do lançamento do ChatGPT, o primeiro chatbot com IA generativa disponibilizado para o grande público, vemos inúmeros casos positivos e negativos em seu uso, chegando em extremos preocupantes como fake news em campanhas eleitorais e pornografia infantil.

Algumas iniciativas louváveis de regulamentação já despontam internacionalmente. No Reino Unido, a Cúpula de Segurança de IA reuniu representantes de 28 países, incluindo Brasil, EUA e China, além de líderes influentes da tecnologia, que assinaram a Declaração de Bletchley.

O documento ressalta a importância da cooperação internacional na avaliação e mitigação dos perigos representados pelos sistemas de IA mais avançados e reconhece o potencial de danos graves e catastróficos decorrentes do uso irresponsável ou não intencional desses modelos.

Nos EUA, Joe Biden assinou uma ordem executiva que reúne 25 agências do governo para a supervisão da IA e exige a avaliação dos riscos de segurança nacional antes da disponibilização dessas tecnologias ao público, impedindo, por exemplo, que sejam utilizadas para o desenvolvimento de armas químicas, biológicas ou nucleares.

Já na União Europeia, após anos de negociações e aprimoramento entre legisladores e representantes dos países-membros, o parlamento aprovou na última semana a versão final do acordo histórico AI Act, que, se for incorporado pelos países, pode se tornar a primeira legislação do gênero no mundo.

O texto, que já é referência no tema, propõe regulamentação rigorosa, com a imposição de multas pesadas para o descumprimento da lei, e a restrição ao uso de reconhecimento facial, vigilância em tempo real e tecnologias biométricas, com exceções no campo da segurança e do combate ao terrorismo.

No Brasil, ao menos quatro projetos de lei que buscam regulamentar a IA tramitam no Congresso. O PL 2.338/23 é considerado o mais completo. A proposta brasileira se assemelha à legislação europeia em diversos aspectos, como a avaliação das tecnologias de IA em níveis hierárquicos de risco e a criação de ambientes regulatórios experimentais, mas ainda patina, entre outros quesitos, em relação à definição das autoridades competentes para a fiscalização.

Um dos pontos centrais da regulação deve ser a transparência. Um estudo da Universidade de Stanford analisou o índice de transparência dos dez principais modelos de linguagem de IA em termos de divulgação das fontes de dados de treinamento, informações sobre hardware e mão de obra envolvidas, entre outros. O mais bem-colocado no sistema foi o Llama 2, da Meta, com um índice de transparência ainda assim baixo, de 54%. GPT-4 (OpenAI) e PaLM 2 (Google) aparecem empatados em terceiro lugar, com 40%.

Também é preciso atentar para as estruturas e práticas de governança das empresas. Vimos recentemente o caso emblemático da OpenAI, que demitiu seu CEO, Sam Altman, para restituí-lo menos de uma semana depois com um novo conselho administrativo após os funcionários ameaçarem uma demissão em massa.

Segundo a Reuters, especula-se que o motivo dessas desavenças seria o desenvolvimento de um novo algoritmo, chamado Q*, que daria ao ChatGPT a capacidade de "aprender sozinho" ao realizar operações matemáticas e de acumular conhecimento à medida que raciocina.

Esse caso sublinhou a necessidade de governança robusta e inovadora, com enfoque na responsabilização. Isso implica aderir a princípios éticos e a uma rigorosa conformidade legal, devendo incluir, por exemplo, pesquisadores independentes com acesso em tempo real ao desenvolvimento da tecnologia, tomando as devidas medidas para evitar a espionagem industrial. Até as ferramentas de código aberto precisam passar pelo mesmo cuidado regulatório, pois seu uso em mãos erradas pode ser nefasto.

Contemplando esse amplo aspecto da governança e da regulamentação, é necessário permitir a aproximação de pesquisadores públicos, sem violar os preceitos da iniciativa privada. A academia, agências regulatórias e centros de pesquisa públicos precisam participar desse movimento. As novas regulamentações poderiam, por exemplo, prever a destinação de parte do lucro obtido com a IA para que a produção científica e o monitoramento ético tenham fôlego para acompanhar o setor.

Nesse sentido, é louvável a iniciativa da Academia Brasileira de Ciências, que lançou um documento para o desenvolvimento responsável da IA no Brasil. O órgão reforça a importância de aumentar os investimentos na área, tanto em infraestrutura quanto em capacitação profissional. O documento também ressalta que o Brasil precisa se posicionar não apenas como importador, mas produtor dessa tecnologia e, para isso, necessita de políticas assertivas para a retenção de talentos no país.

Tema importante, inclusive, em todas as esferas de poder, que deve estar em pauta nas próximas eleições municipais, em especial nos grandes municípios que possuem importantes polos universitários: quais candidatos terão propostas para a criação de clusters, territórios e hubs no campo da IA, em consonância com as esferas estadual e federal? Imprescindível não ficarmos para trás nessa corrida.

O debate em torno do desenvolvimento da IA não pode ficar restrito apenas aos atores já consolidados. A magnitude dessa mudança é profundamente transformadora para a humanidade. É crucial, portanto, que o setor público, a academia, as empresas e a sociedade civil se envolvam, dialoguem e trabalhem coordenadamente.

Essa confluência de pontos de vista será decisiva para garantir que a IA não aprofunde as desigualdades no Brasil e no mundo, mas se torne uma ferramenta verdadeiramente inclusiva, de forte finalidade pública e para o desenvolvimento da humanidade.

Assim como a caixa de Pandora dos gregos, o mundo da IA carrega grandes ameaças e um atributo central: a esperança. Não podemos nos dar ao luxo de desperdiçar essa que pode ser a maior das nossas oportunidades.

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.