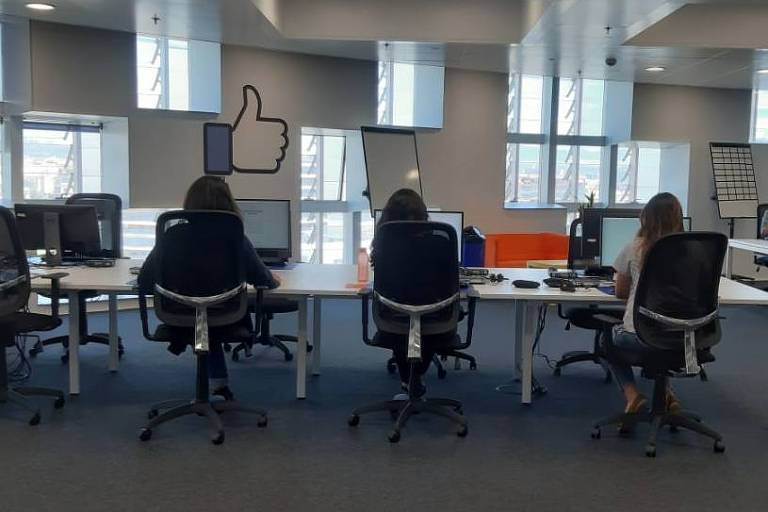

Na famosa Torre Agbar, um dos poucos arranha-céus espelhados de Barcelona, 800 pessoas trabalham dia e noite para remover conteúdos com teor violento publicados no Facebook, de suicídio e exploração sexual a racismo e xenofobia.

Elas ficam em salas iluminadas, com cerca de 70 lugares e vista panorâmica —mais modernas que uma repartição pública e menos sofisticadas que um escritório da rede social. Os profissionais ganham até € 2,1 mil euros (R$ 9.400) para interpretar o que está ou não de acordo com as políticas de segurança do Facebook.

Com pouco mais de um ano, o centro de moderação de conteúdo espanhol é um dos quatro criados em 2018 e um dos 20 espalhados pelo mundo.

A empresa de Mark Zuckerberg, alvo de pressões da sociedade civil, dos governos e da mídia nos últimos anos, tenta estancar danos de massacres, suicídio de jovens e incitação ao ódio veiculados em vídeos, textos ou fotos. A plataforma tem 2,3 bilhões de usuários —30% da humanidade.

As equipes de moderadores são terceirizadas, contratadas por multinacionais como CCC ou Accenture. O mantra entre revisores brasileiros, que não podem ter os nomes revelados, é foco na execução técnica do trabalho.

Há treinamento sobre as políticas do Facebook, que são documentos extensos abertos, e incluem mais de 20 categorias impróprias.

Bullying e discurso de ódio, mais interpretativos, têm percentual menor. No segundo caso, 34,6% são banidos do Facebook por revisão humana.

“Adoraríamos chegar ao ponto em que nossa tecnologia estivesse apta a detectar crime ou suicídio, mas não é uma solução mágica”, diz Simon Cross, gerente de produto na área de integridade. Os problemas são os falsos negativos.

Em três meses, 4 milhões de posts de discurso de ódio excluídos podem parecer pouco diante de bilhões de publicações diárias, mas são o grande problema quando o assunto é moderação.

“Não há definição global de discurso de ódio. O que é descrito como crime em um país não é necessariamente em outro”, diz Paula Garuz Naval, gerente de política de produtos de segurança.

Para driblar a falta de consenso de jurisdições nacionais, o Facebook cria a sua própria. Em 2020, será implementada uma espécie de suprema corte independente, que analisará assuntos sensíveis.

O comitê será formado por 40 pessoas de diversas nacionalidades e formações. O primeiro time será escolhido pelo Facebook. Após um mandato de três anos, o próprio comitê desenhará o modelo das eleições da nova equipe.

Para Francisco Brito Cruz, advogado e diretor do InternetLab, que participou de um dos encontros que discutiu o comitê, a iniciativa demonstra um caso de convivência de ordem normativa estatal com ordem normativa privada.

O desafio, segundo ele, é que o conselho não funcione para acirrar a polarização política. “É preciso analisar exemplos de cortes que dão certo e errado para garantir que não vire um palco para performances.”

Já Luca Belli, professor de governança e regulação de internet na FGV, também envolvido no debate, afirma que o Facebook adota essa postura para ganhar tempo com governos e órgãos reguladores.

“É uma não solução para um problema real, uma simpática ficção jurídica. Muito mais fácil do que criar um conselho desses é, em vez de perguntar ‘o que está na sua cabeça?’, assegurar que as pessoas saibam que essas políticas já existem. ‘O que você quer compartilhar está de acordo com nossas regras’ seria uma saída”, diz.

Ele reforça que pessoas mais informadas geram um ambiente de mais segurança.

A repórter viajou a convite do Facebook

Comentários

Os comentários não representam a opinião do jornal; a responsabilidade é do autor da mensagem.